WormGPT. Co trzeba wiedzieć o cyberprzestępczej wersji ChatGPT?

-

- 19.07.2023, godz. 19:57

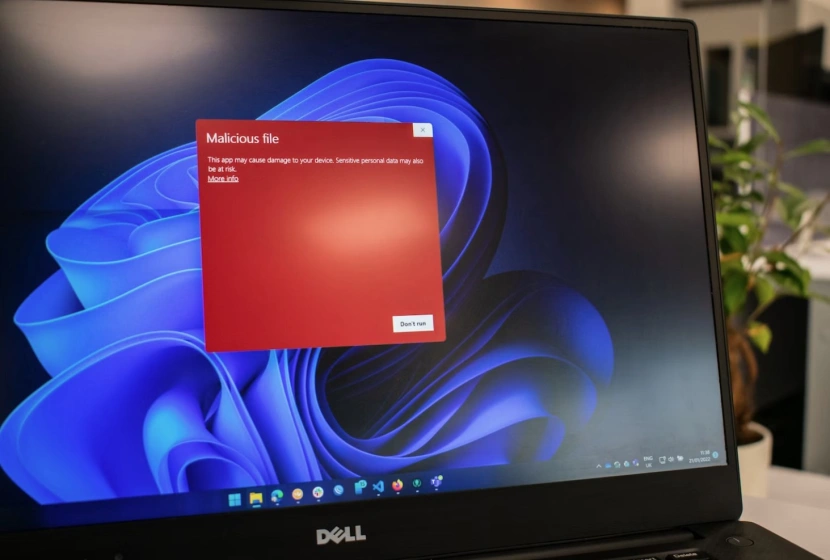

Zawsze kiedy pojawia się nowa innowacja technologiczna, tworzą się także ścieżki do jej nadużywania. Było tylko kwestią czasu, zanim chatbot AI zostałby skopiowany do celów złośliwych - i takie narzędzie jest już na rynku, znane jako WormGPT.

ChatGPT doczekał się złośliwego kuzyna / Fot. Ed Hardie, Unsplash.com

Co to jest WormGPT? 13 lipca badacze z firmy zajmującej się cyberbezpieczeństwem, SlashNext, opublikowali post na blogu, w którym ujawnili odkrycie WormGPT.

Zgodnie z informacjami użytkownika forum z dark webu, projekt WormGPT ma na celu stworzenie "alternatywy" dla ChatGPT, która pozwala "robić różnego rodzaju nielegalne rzeczy i łatwo je sprzedawać online w przyszłości".

Zobacz również:

- Blaski i cienie AI

- Z usług bota ChatGPT będzie można korzystać bez konieczności rejestrowania się na witrynie OpenAI

SlashNext uzyskało dostęp do narzędzia, opisanego jako moduł AI oparty na modelu języka GPTJ. WormGPT rzekomo został wyszkolony na danych zawierających informacje związane z złośliwym oprogramowaniem, ale konkretne zestawy danych są znane tylko autorowi WormGPT.

Możliwe, że WormGPT jest w stanie generować złośliwe kody lub przekonujące e-maile phishingowe.

Do czego używany jest WormGPT?

WormGTP jest opisywany jako "podobny do ChatGPT, ale nie ma żadnych etycznych granic".

ChatGPT ma zestaw reguł, które mają na celu zapobieganie nieetycznemu wykorzystaniu chatbota. Obejmuje to odmowę realizacji zadań np. związanych z przestępstwami i złośliwym oprogramowaniem.

Badacze byli w stanie użyć WormGPT do "wygenerowania e-maila mającego na celu naciskanie nieświadomego menedżera konta na opłacenie fałszywej faktury". Zespół był zaskoczony, jak dobrze model języka poradził sobie z zadaniem, określając wynik jako "niezwykle przekonujący" i także "strategicznie przebiegły".

Twórca WormGPT tworzy już podobno model subskrypcji, chcąc oferować narzędzie w cenie od 60 do 700 dolarów. Członek kanału na Telegramie, gdzie odbywa się odpowiednia dyskkusja, twierdzi że jest już ponad 1500 użytkowników WormGPT.

Czy WormGPT to to samo, co ChatGPT?

Nie. ChatGPT został opracowany przez OpenAI, natomiast WormGMT nie jest twórczością tej organizacji. Jest przykładem, jak cyberprzestępcy mogą czerpać inspiracje z zaawansowanych chatbotów AI, aby opracować swoje własne złośliwe narzędzia.

Nawet w rękach początkujących i typowych oszustów modele języka naturalnego mogą zamienić proste, łatwe do uniknięcia phishingowe oszustwa w zaawansowane operacje, które mają większe szanse na powodzenie. Nie ma wątpliwości, że tam, gdzie można zarobić pieniądze, cyberprzestępcy będą podążać za tropem - a WormGPT to dopiero początek nowego zakresu narzędzi cyberprzestępczych, które mają być sprzedawane na czarnym rynku.

Europol stwierdził w raporcie z 2023 roku, "Wpływ dużych modeli językowych na egzekwowanie prawa", że "kluczowe będzie monitorowanie [...] rozwoju, ponieważ LLM (duże modele językowe) szkolone do ułatwiania szkodliwej produkcji mogą stać się kluczowym modelem biznesowym przestępczości w przyszłości. Stanowi to nowe wyzwanie dla organów ścigania, dla których będzie łatwiejsze niż kiedykolwiek przestępstwo ze strony podmiotów złośliwych, bez konieczności posiadania wcześniejszej wiedzy informatycznej".

UK National Crime Agency ostrzega zaś, że AI może spowodować eksplozję ryzyka dla młodych ludzi i nadużycia.

Czy ChatGPT może być używany do celów nielegalnych?

Nie bez ukrytych taktyk, ale z odpowiednimi sugestiami wiele modeli języka naturalnego można przekonać do konkretnych działań i zadań.

Badacze z SlashNext mówią, że cyberprzestępcy mogą używać takiej technologii do automatycznego tworzenia wysoce przekonujących fałszywych e-maili, personalizowanych do odbiorcy, co zwiększa szanse powodzenia ataku.