Serwery i pamięć masowa - efektywność ponad wszystko

-

- Szymon Pomorski,

- 15.03.2010

Do zakupowego boomu w IT wciąż daleka droga, ale stabilniejsza sytuacja gospodarcza i nowe potrzeby skłaniają do stopniowego uwalniania budżetów i rozpoczynania lub wznawiania rozpoczętych projektów. W tym roku, podobnie jak w minionym, decyzjami zakupowymi kierować będzie chęć zwiększenia efektywności i wydajności.

Wirtualizacja i konsolidacja, rosnąca moc obliczeniowa i jej efektywne wykorzystanie oraz obniżanie poboru energii to dominujące trendy na rynku serwerów. W portfolio producentów serwerów na dobre zadomowiły się modele, zaprojektowane specjalnie na potrzeby wirtualizacji. Urządzenia te cechuje przede wszystkim duża liczba wielordzeniowych procesorów oraz pamięci operacyjnej RAM, co maksymalizuje moc obliczeniową dostępną do wykorzystania przez maszyny wirtualne. Wiele modeli serwerów oferuje również możliwość wyposażenia ich w dyski SSD, co jeszcze bardziej podnosi poziom wydajności całego systemu. Nie maleje popularność serwerów kasetowych (blade), stanowiących najbardziej dynamicznie rozwijający się segment rynkowy. Warto również zwrócić uwagę na oferowane przez niektórych producentów Rozwiązania typu “unified", które składają się z serwerów, macierzy dyskowej i łączącego je przełącznika, oferując gotowy zestaw, na którym można wdrożyć systemy produkcyjne.

Patrząc na pamięć masową w centrach danych, głównym problemem staje się efektywne i optymalne sprostanie nieustannemu przyrostowi danych, zwłaszcza strukturalnych, poprawa wydajności działania oraz konwergencja i uproszczenie procesu zarządzania posiadanymi zasobami. Producenci rozwiązań oferują w swoich portfolio wiele metod i technologii, które mogą pomóc w poradzeniu sobie z tymi problemami. Technologie lepszej utylizacji przestrzeni pamięci masowej, konsolidacja, konwergencja czy archiwizacja i optymalizacja składowania danych - mają przyczynić się do efektywniejszego wykorzystania zasobów pamięci masowej w centrum danych.

Deduplikacja

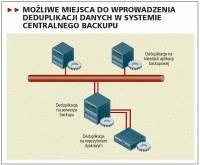

Możliwe miejsca do wprowadzenia deduplikacji danych w systemie centralnego backupu