Pamięć przyszłości

-

- Jarosław Badurek,

- 14.11.2005

Echa sportowego paradygmatu ''dalej, wyżej, szybciej'' odnajdziemy także w informatyce. W obszarze zapamiętywania danych można by go przybliżyć hasłem ''więcej, gęściej, szybciej, taniej''. Nowe technologie zaoferują nam terabajtowe dyski - o rzędy wielkości pojemniejsze niż obecne.

Echa sportowego paradygmatu ''dalej, wyżej, szybciej'' odnajdziemy także w informatyce. W obszarze zapamiętywania danych można by go przybliżyć hasłem ''więcej, gęściej, szybciej, taniej''. Nowe technologie zaoferują nam terabajtowe dyski - o rzędy wielkości pojemniejsze niż obecne.

Przede wszystkim trzeba sobie zadać pytanie, czy w ogóle potrzeba nam tych nowych opcji pamięciowych? Owszem, postęp ludzkości nie byłby możliwy, gdybyśmy nie dysponowali pamięcią. Podobnie jak komputer, nasz mózg nie miałby danych do wykonywania swego programu. Dysponujemy zatem pamięcią w wymiarze biologicznym (genetycznym). Mając jednak tylko taką pamięć, nie różnilibyśmy się od zwierząt, których rozwój ogranicza się do kolejnych mutacji, wyznaczanych przez zmiany środowiskowe (warto zwrócić uwagę na to, że naturalna pamięć kulturowa człowieka mogła pojawić się już przed opanowaniem mowy przez nasz gatunek - przejawem jej istnienia jest międzypokoleniowy przekaz rytuałów czy zachowań; przede wszystkim zaś wszelkie efekty materialnej działalności, przeobrażającej otoczenie - np. proste budowle czy naskalne malunki).

Każdy trwały znak, choćby kamień postawiony na kamieniu, i każdy przedmiot wykonany ludzką ręką zawierał ładunek informacyjny, przeznaczony także dla innego człowieka. Była to już pierwotna pamięć materialna. Mowa wzbogaciła ją o wymiar przekazu ustnego - ulotnego, lecz niezwykle precyzyjnego. Sytuację tę zmienia wielki wynalazek pisma. Pojawia się pierwsze medium, określane historycznie słowem: papier (faktycznie ów nośnik pojawia się później: u początków pisma mamy wszak do czynienia z glinianymi rytami, węzełkowym kipu czy muszelkowym aroko, nie mówiąc o wołowej skórze).

To już zatem pamięć medialna i trwała, ale jeszcze nie masowa. Z tą będziemy mieli do czynienia dopiero od czasu eksplozji "galaktyki Gutenberga", związanej z wynalazkiem druku. Wreszcie dochodzimy do najbardziej uniwersalnej pamięci maszynowej, jaką jest multimedialna pamięć komputerowa, w szczególności internetowa. Tymczasem otaczające nas technologie informatyczne stają się coraz bardziej "pamięciożerne". Nic dziwnego - czarno-biały zapis tekstowy w trybie znakowym dawno przestał nam wystarczać. A informacja "kolorowa", "mówiąca" i "ruszająca się" oznacza znacznie większe zapotrzebowanie na pamięć. Co więcej, wszystko musi mieścić się w kieszeni, bo popularne komórki ciągle zyskują na funkcjonalności, daleko wychodząc poza ich pierwotny cel, jakim była rozmowa telefoniczna. Dziś robimy nimi także zdjęcia, bawimy się elektronicznymi grami czy korzystamy z biznesowych aplikacji online.

Pamięć dla Wszechnetu

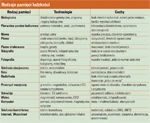

Rodzaje pamięci ludzkości

Co ciekawe, co najmniej od czasów alarmistycznych raportów Klubu Rzymskiego ("Granice wzrostu", 1972 r.), wielokrotnie wypowiadano się na tematy energetyczne, natomiast trudno byłoby spotkać podobne obawy w obszarze informatyki. Byłby to przejaw nieograniczonej wiary w kreatywność informatyków? Zapewne raczej wynik mniejszej znajomości tej dziedziny wiedzy, w porównaniu ze wszystkim, co wiąże się z bardziej medialnymi: węglem, gazem czy ropą. A przecież w obu przypadkach wynik, jaki pojawi się na końcu procesu rozwiązywania stawianych nam przez życie zadań, będzie taki sam: pozytywny, tzn. że uda nam się przejść na nowe technologie energetyczne i pojawią się też wydajniejsze rodzaje pamięci. Cywilizacyjny rozwój nie zostanie zastopowany (a przynajmniej tak było "od zawsze"). Przyjrzyjmy się zatem aktualnej sytuacji w dziedzinie mediów pamięciowych.

Kluczowym parametrem jest ich gęstość zapisu danych. Jej pochodną jest bowiem pojemność medium, a w dalszej kolejności cena i szybkości transmisji. Dla ustalenia uwagi spójrzmy na transportery danych, czyli urządzenia przenośne, takie jak 1-calowy HardPocketDrive Seagate, który ze złączem USB i pojemnością 5 GB stanowi interesującą alternatywę dla mniej pojemnych sztyfcików (stick) tego typu. Nieco większy, przenośny dysk tej samej firmy, 3,5-calowa Barracuda 7200.8, może pomieścić 400 GB danych, operując gęstością ok. 80 Gb/cal2. Jest to charakterystyczna wartość w górnym obszarze możliwości współczesnych dysków, które wyznacza granica 100-120 Gb/cal2.

Gorące magnesy

Tyle da się "wyciągnąć" wzdłużnym zapisem magnetycznym (longitudinal recording). W tej metodzie fizyczną reprezentacją danych są domeny magnetyczne, jak wspomnieliśmy, równoległe do powierzchni dysku. Powyżej wymienionej granicy ich energia cieplna przewyższa ferromagnetyczną i medium zyskuje własności superparamagnetyczne. Niestety, ten ładnie brzmiący przymiotnik nie oznacza nic dobrego - ciepło po prostu zniszczyłoby ustalony porządek magnetyczny bitów, co równałoby się utracie informacji. A gdyby tak przejść do pionowych magnesików? Faktycznie, zejście nieco w głąb dysku w praktyce okazuje się dobrym pomysłem, wykorzystywanym w metodzie zapisu prostopadłego (perpendicular recording).

W ten sposób można przesunąć granicę superparamagnetyczną do 500 Gb/cal2. Hitachi już osiągnęło w swoich laboratoriach ok. 250 Gb/cal2 i zapowiada wejście nowych dysków na rynek w najbliższych miesiącach. Ich mechanika jest bardziej precyzyjna, gdyż konieczność odczytu mniejszych domen wymaga obniżenia wysokości "lotu" głowic pisząco-czytających. Jednocześnie potrzebne jest użycie silniejszych pól magnetycznych, aby zniwelować efekty superparamagnetyczne. Tu z pomocą przychodzi technologia zapisu termiczno-magnetycznego H/TAMR (Heat/Thermally Assisted Magnetic Recording). W tej metodzie laser najpierw ogrzewa dysk w miejscu przewidzianym do zapisu danych.

Ciepłe medium pozwala na użycie mniejszych pól magnetycznych do zapamiętania danych, które zachowują trwałość po procesie ochłodzenia.

W ten sposób można przesunąć magiczną "super-para-granicę" aż do 1 Tb/cal2. Dla naszej przykładowej Barracudy oznaczałoby to 12,5-krotny wzrost gęstości, czyli pojemność 5 terabajtów (5000 GB). Producenci prognozują, że termiczno-magnetyczne media osiągną rynkową dojrzałość w ciągu 4-6 lat. Zwróćmy uwagę, że te przewidywania dość dokładnie korespondują z prawem Moore'a, które w zależności od 3- lub 4-krotnego podwojenia cyklicznego w tym czasie zakłada wzrost gęstości odpowiednio o 8 lub 16 razy.

Alternatywną metodą, pozwalającą na osiąganie podobnych gęstości danych, jest użycie mediów wzorcowanych (strukturalnych) - patterned media. W odróżnieniu od typowych dysków, gdzie magnetyczne drobiny są przypadkową mozaiką, mamy tu do czynienia ze wzorami precyzyjnie wycinanymi w materiale magnetycznym za pomocą strumienia jonów. Taka strukturyzacja mediów pozwala na zmniejszenie rozmiaru domen, co również prowadzi do uzyskania pojemniejszych dysków. Na pewno więc w bliskiej przyszłości nie grozi nam stanięcie przed barierą wzrostu pamięci masowych.