Gorące technologie 2008

- 09.06.2008

Jesteśmy bombardowani doniesieniami o cudownych rozwiązaniach, mogących zrewolucjonizować branżę IT. Ile w nich jest prawdy, a ile marketingu?

Jesteśmy bombardowani doniesieniami o cudownych rozwiązaniach, mogących zrewolucjonizować branżę IT. Ile w nich jest prawdy, a ile marketingu?

Zastanówmy się, które nowe technologie w sieciach komputerowych mogą w tym roku okazać się prawdziwie innowacyjne. W naszym zestawieniu staraliśmy się zebrać te, które mogą zwiększyć wydajność sieci, podnieść poziom bezpieczeństwa i zaoszczędzić pieniądze.

Sieci bezprzewodowe 802.11n

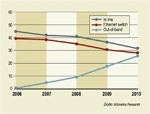

Prognoza sprzedaży urządzeń egzekwujących NAC

Teraz przyszedł czas na zastanowienie się, czy rozwiązania zgodne z 802.11n mają sens w naszej organizacji. Faktem jest, że wciąż w firmach bardzo duża liczba osób pracuje na komputerach stacjonarnych, a nie na laptopach. Przez nich szybka, bezprzewodowa infrastruktura (wciąż postrzegana jako nie tak bezpieczna jak przewodowa) prawdopodobnie nigdy nie będzie wykorzystana. Pozostaje zastosowanie w specyficznych środowiskach - hotelach, szpitalach, uniwersytetach, gdzie pojawia się bardzo duża liczba użytkowników rozwiązań mobilnych.

W przeprowadzonych testach rozwiązania 802.11n sprawdzają się oczywiście lepiej niż 802.11 a/b/g, ale nie tak idealnie, jak można by się tego spodziewać. Teoretyczna maksymalna szybkość to 300 Mb/s, ale w praktyce najczęściej osiąga się transfery na poziomie 130 Mb/s. Ten fakt nie powinien jednak dziwić, jako że przy standardzie 802.11b obiecywano 11 Mb/s, a w rzeczywistości udało się osiągnąć 5 Mb/s (przy 802.11g - odpowiednio 54 Mb/s oraz 20 Mb/s). Jednak przy 802.11n realne 130 Mb/s wobec 20 Mb/s to i tak duży sukces.

Kolejną korzyścią jest znacznie większy zasięg. W testach, przy próbach odtwarzania filmu, nieprzerwana transmisja była nawet przy odległości 70-75 m od punktu dostępowego.

Standard 802.11n zaspokoi większość potrzeb związanych z transmisją danych, głosu i obrazu. Ale czy opłaca się inwestować w całkowicie nową infrastrukturę już teraz? Chyba jednak warto jeszcze chwilę zaczekać...

Network Access Control

Kontrola dostępu do sieci (Network Access Control - NAC) to technologia, która ma zabezpieczać, aby użytkownicy powracający z podróży służbowej nie infekowali sieci przedsiębiorstwa wirusami nabytymi w podróży, a partnerzy biznesowi, z okazyjnym dostępem do sieci, nie mieli możliwości podjęcia szkodliwych działań lub uzyskania dostępu do poufnej informacji. Ma również zapewniać, by użytkownicy byli właściwie uwierzytelniani i mieli dostęp wyłącznie do aplikacji, które są im niezbędne w pracy.

Spełnienie tych postulatów nie jest łatwe. W tym zakresie istnieje wiele konkurencyjnych standardów i podejść do problemu, m.in. Trusted Computing Group ze swoją architekturą Trusted Network Connect. Wielu dostawców oferuje wycinkowe produkty obsługujące architekturę TNC.

Cisco ma własną strukturę - CNAC. Firma oferuje produkty wpisujące się w tę strukturę, a także produkty niezależne. Przy czym aktualne urządzenia NAC Cisco i jego struktura NAC wykorzystują odmienne oprogramowanie klienckie do oceny kondycji punktów końcowych sieci. Było to tak kłopotliwe dla użytkowników, że w sierpniu 2007 r. producent podjął próbę unifikacji własnej, dwudrożnej strategii, udostępniając oneNAC.

Następny był Microsoft. Firma nie używa nawet terminu NAC, wprowadzając własną nazwę: Network Access Protection (NAP), ale produkty, jakie pojawiły się do tej pory, stwarzają raczej nowe wyzwania niż dają kompleksowe rozwiązanie problemu; serwer polityk NAP nie pojawi się przed udostępnieniem Windows Server 2008. Co w tej sytuacji mają robić użytkownicy? Na szczęście produkty NAC mogą współdziałać i już teraz są możliwe pewne opcje.

NAC może realizować kontrolę typu "pre-admission", która jest wykonywana przed uzyskaniem dostępu do sieci, blokując dostęp zainfekowanym maszynom, a także nieautoryzowanym użytkownikom. Jednak bardziej interesujące jest zastosowanie kontroli typu "post-admission" zapewniającej, że punkty końcowe pozostają w zgodzie z obowiązującą polityką bezpieczeństwa już po uzyskaniu dostępu do sieci.

Jedną z większych zmian od czasu pojawienia się pierwszych rozwiązań NAC jest wykorzystywanie obsługi 802.1x w przełącznikach sieciowych. W miarę upływu czasu coraz więcej organizacji odświeża swoją infrastrukturę przełączników, uwzględniając 802.1x, i w ten sposób przystosowuje ją do wsparcia NAC, bez konieczności stosowania oddzielnych urządzeń egzekwujących.

Kolejna nadchodzi wraz z serwerem NAP Microsoftu. W połączeniu ze zintegrowanym klientem NAP/NAC w Vista, jak również Windows XP Service Pack 3 wyposażonym w funkcjonalność NAP, będzie on ułatwiał wielu użytkownikom podjęcie decyzji o przyjęciu takiego rozwiązania za podstawę ich projektów kontroli dostępu.

NAP opiera się na różnych urządzeniach sieciowych przy egzekwowaniu reguł polityki, ale nie wymaga dołączania do sieci urządzeń specjalnie przeznaczonych do wykonywania tych funkcji. Server 2008 niekoniecznie musi by elementem takich wdrożeń.

Jeżeli organizacja nie jest przygotowana do wdrożenia pełnej struktury NAC, a tylko chce włączyć do sieci wycinkowe jej urządzenia, to ma do wyboru wiele opcji.

Zarządzający IT muszą więc przeanalizować swoje potrzeby i horyzont czasowy oraz podjąć decyzję, czy wdrażać pojedyncze urządzenia, czy całą strukturę. Jeżeli strukturę, to którą? Nie jest to jednak decyzja łatwa, ale czasami lepiej ją podjąć wcześniej niż później.